An der Schwelle einer neuen Ära

Die Robotik steht heute an einem entscheidenden Wendepunkt. Während Roboter in der Vergangenheit hauptsächlich für einfache, repetitive Aufgaben eingesetzt wurden, dringen sie nun in Bereiche vor, die komplexe Entscheidungen, soziale Interaktionen und moralische Urteile erfordern. Diese Entwicklung wirft grundlegende ethische Fragen auf, die weit über technische Aspekte hinausgehen und an den Kern unseres Menschseins und unserer gesellschaftlichen Werte rühren.

In einer Zeit, in der autonome Fahrzeuge in Sekundenbruchteilen lebenswichtige Entscheidungen treffen müssen, Pflegeroboter für vulnerable Menschen sorgen und KI-gestützte Systeme über Kreditwürdigkeit, Stellenbesetzung oder medizinische Behandlungen mitentscheiden, wird die Auseinandersetzung mit Roboterethik zu einer gesellschaftlichen Notwendigkeit.

Grundlegende ethische Fragestellungen

Die Ethik der Robotik umfasst verschiedene Dimensionen, die eng miteinander verwoben sind:

Autonomie und Verantwortung

Mit zunehmender Autonomie von Robotersystemen wird die Frage der Verantwortung immer komplexer:

- Wer trägt die Verantwortung für Entscheidungen autonomer Systeme? Der Hersteller, der Programmierer, der Nutzer oder das System selbst?

- Kann Verantwortung überhaupt an nicht-menschliche Akteure delegiert werden? Und wenn ja, in welchem Umfang?

- Wie können wir Systeme so gestalten, dass Verantwortlichkeit nachvollziehbar bleibt? Die "Black Box"-Natur vieler KI-Algorithmen erschwert die Zuordnung von Verantwortung erheblich.

Autonome Fahrzeuge müssen in Extremsituationen ethische Entscheidungen treffen, die bisher Menschen vorbehalten waren. Wer trägt die Verantwortung für diese Entscheidungen?

Menschenwürde und Autonomie

Der Einsatz von Robotern in sensiblen Bereichen wie Pflege, Bildung oder Therapie wirft Fragen zur Wahrung der Menschenwürde auf:

- Wie verändern Roboter die menschliche Autonomie? Während sie einerseits die Selbstständigkeit unterstützen können, besteht andererseits die Gefahr neuer Abhängigkeiten.

- Kann die Betreuung durch Roboter die menschliche Fürsorge adäquat ersetzen? Besonders bei vulnerablen Gruppen wie älteren Menschen oder Kindern ist dies eine zentrale Frage.

- Wie wahren wir die Privatsphäre und Selbstbestimmung? Roboter sammeln umfangreiche Daten über ihre Nutzer, was Fragen des Datenschutzes und der informationellen Selbstbestimmung aufwirft.

"Die ethischen Fragen der Robotik sind nicht in erster Linie Fragen über Roboter, sondern Fragen über uns selbst. Sie zwingen uns, unsere Werte, unsere Menschlichkeit und unsere Vorstellung vom guten Leben zu reflektieren." — Prof. Dr. Catrin Misselhorn, Philosophin und Ethikerin

Arbeitsmarkt und soziale Gerechtigkeit

Die zunehmende Automatisierung durch Roboter hat tiefgreifende sozioökonomische Auswirkungen:

- Wie gehen wir mit Arbeitsplatzverlusten durch Automatisierung um? Während neue Jobs entstehen, verschwinden andere, oft mit unterschiedlichen Qualifikationsanforderungen.

- Wie verteilen wir den durch Automatisierung geschaffenen Wohlstand? Die Konzentration der Gewinne bei wenigen Unternehmen könnte bestehende Ungleichheiten verstärken.

- Welche neuen Formen der Arbeit und sozialen Absicherung benötigen wir? Konzepte wie das bedingungslose Grundeinkommen werden als mögliche Antworten diskutiert.

Transparenz und Vertrauen

Vertrauen in robotische Systeme setzt Transparenz und Nachvollziehbarkeit voraus:

- Wie können wir komplexe KI-Systeme für Nutzer verständlich machen? Die sogenannte "erklärbare KI" (XAI) ist ein wichtiges Forschungsfeld.

- Welche Informationen über Funktionsweise und Grenzen müssen offengelegt werden? Nutzer sollten wissen, wonach ein System entscheidet und welche Daten es sammelt.

- Wie kann Täuschung verhindert werden? Insbesondere bei sozialen Robotern besteht die Gefahr, dass sie menschliche Emotionen und Beziehungen simulieren.

Roboterethik in spezifischen Anwendungsbereichen

Die ethischen Herausforderungen manifestieren sich besonders deutlich in bestimmten Anwendungsfeldern:

Militärische Robotik

Autonome Waffensysteme werfen besonders schwerwiegende ethische Fragen auf:

- Sollten Maschinen über Leben und Tod entscheiden dürfen? Viele Ethiker und Organisationen fordern ein präventives Verbot tödlicher autonomer Waffensysteme.

- Wie verändert die Distanzierung vom Kriegsgeschehen die Hemmschwelle zur Gewaltanwendung? Die "Entmenschlichung" des Krieges durch Robotik könnte Konflikte wahrscheinlicher machen.

- Kann ein Roboter die Prinzipien des humanitären Völkerrechts adäquat umsetzen? Die Unterscheidung zwischen Kombattanten und Zivilisten erfordert kontextbezogene Urteile.

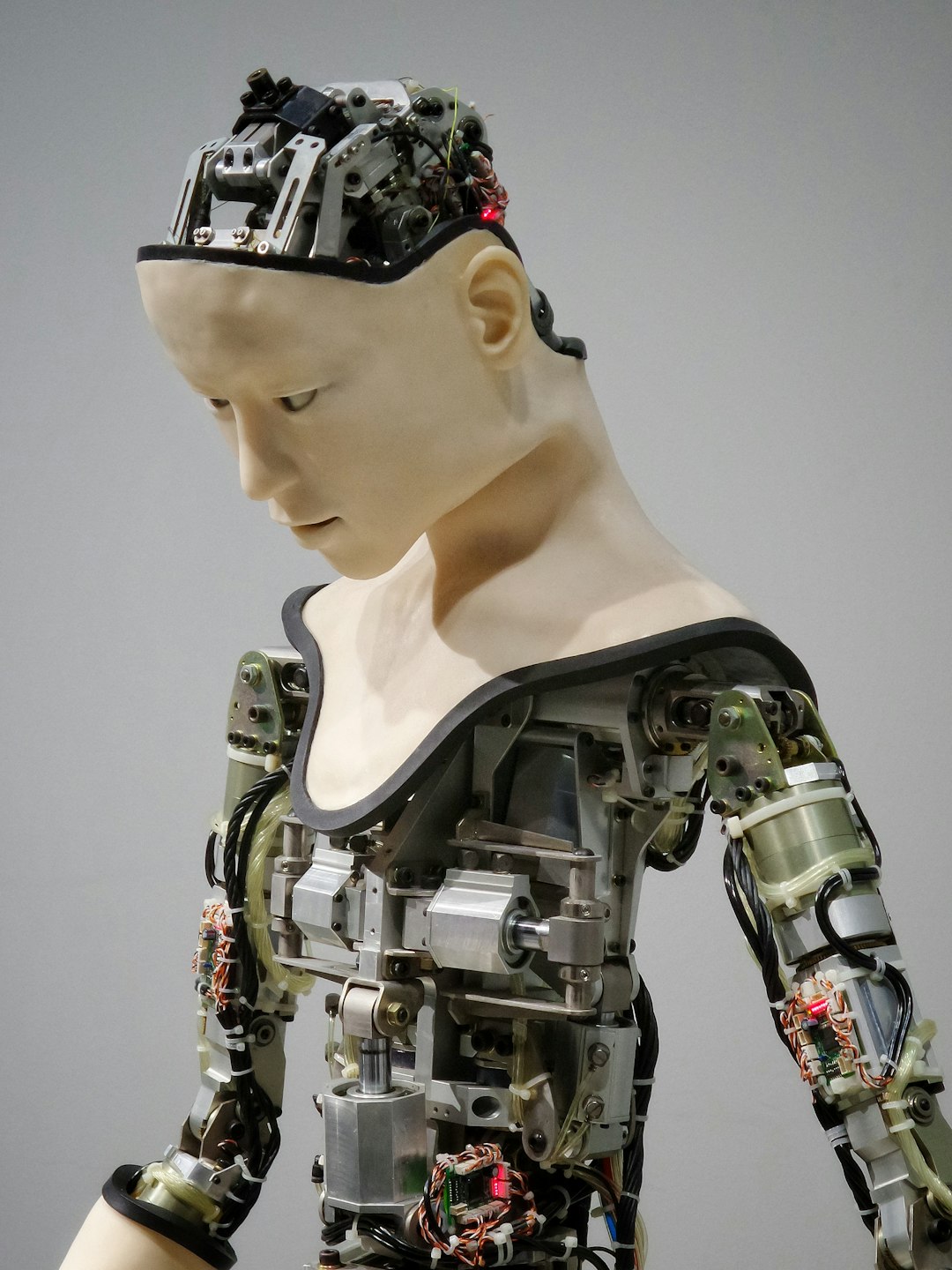

Gesundheitswesen und Pflege

Im medizinischen Bereich geht es um sensible Entscheidungen und intime Situationen:

- Wie viel menschlichen Kontakt brauchen Patienten? Besonders in der Pflege ist die menschliche Zuwendung ein wesentlicher Faktor.

- Wie können Pflegeroboter kulturelle und individuelle Sensibilitäten berücksichtigen? Pflege ist stark kulturell geprägt und erfordert Einfühlungsvermögen.

- Wer entscheidet über den Einsatz von Robotern in der Pflege? Die Selbstbestimmung der Betroffenen muss gewahrt bleiben.

Autonome Fahrzeuge

Selbstfahrende Autos stehen vor komplexen moralischen Dilemmata:

- Wie sollen autonome Fahrzeuge in unvermeidbaren Unfallsituationen entscheiden? Das bekannte "Trolley-Problem" wird zu einer praktischen Frage der Programmierung.

- Nach welchen Kriterien soll priorisiert werden? Alter, Anzahl der gefährdeten Personen, Wahrscheinlichkeit des Überlebens?

- Wer legt diese Kriterien fest? Hersteller, Regierungen, Ethikkommissionen oder die Gesellschaft als Ganzes?

Soziale Roboter und künstliche Gefährten

Roboter, die soziale und emotionale Bedürfnisse ansprechen, werfen besondere Fragen auf:

- Wie authentisch sind Beziehungen zu Robotern? Die Simulation von Empathie und Emotionen kann zu Täuschungen führen.

- Besteht die Gefahr einer Verarmung menschlicher Beziehungen? Künstliche Gefährten könnten reale Beziehungen ersetzen oder ergänzen.

- Welche psychologischen Auswirkungen hat die Interaktion mit sozialen Robotern? Besonders bei Kindern und vulnerablen Gruppen sind die Langzeitfolgen noch unerforscht.

Ansätze zur ethischen Gestaltung der Robotik

Um die ethischen Herausforderungen der Robotik zu bewältigen, werden verschiedene Ansätze verfolgt:

Ethische Leitlinien und Prinzipien

Zahlreiche Organisationen haben Richtlinien für eine ethische Robotik entwickelt:

- Asimovs Robotergesetze: Bereits 1942 formulierte der Science-Fiction-Autor Isaac Asimov drei Gesetze für Roboter, die bis heute Diskussionen inspirieren.

- IEEE Global Initiative on Ethics of Autonomous and Intelligent Systems: Entwickelt Standards für ethisches Design.

- EU-Leitlinien für vertrauenswürdige KI: Betonen Transparenz, Nicht-Diskriminierung und menschliche Aufsicht.

Value Sensitive Design

Dieser Ansatz integriert ethische Werte direkt in den Designprozess:

- Identifikation relevanter Werte: Welche Werte (Privatsphäre, Autonomie, Fairness etc.) sind im jeweiligen Kontext besonders wichtig?

- Beteiligung der Stakeholder: Einbeziehung aller Betroffenen in den Designprozess.

- Iterative Evaluation: Kontinuierliche Überprüfung, ob die implementierten Lösungen die angestrebten Werte tatsächlich fördern.

Regulatorische Rahmenwerke

Rechtliche Rahmenbedingungen werden zunehmend an die Herausforderungen der Robotik angepasst:

- EU-Verordnungen zur KI: Kategorisieren KI-Anwendungen nach Risikostufen und stellen entsprechende Anforderungen.

- Haftungsfragen: Entwicklung neuer Haftungsmodelle für autonome Systeme.

- Ethik-Zertifizierungen: Etablierung von Standards und Prüfverfahren für ethisch verantwortungsvolle Robotik.

Ethik-Workshop zur Entwicklung von Pflegerobotern: Die frühzeitige Einbindung verschiedener Perspektiven ist entscheidend für eine ethisch reflektierte Gestaltung.

Bildung und öffentlicher Diskurs

Die ethische Gestaltung der Robotik erfordert einen breiten gesellschaftlichen Dialog:

- Interdisziplinäre Ausbildung: Integration ethischer Reflexion in die Ausbildung von Ingenieuren und Informatikern.

- Öffentliche Beteiligung: Förderung des Bewusstseins für ethische Fragen der Robotik in der breiten Bevölkerung.

- Partizipative Entscheidungsprozesse: Einbeziehung verschiedener gesellschaftlicher Gruppen in Entscheidungen über Regulierung und Einsatz von Robotertechnologien.

Die Zukunft der Roboterethik

Mit der fortschreitenden Entwicklung der Robotik werden auch die ethischen Fragestellungen komplexer und vielschichtiger:

Künstliche Moral und maschinelles Bewusstsein

Die Frage, ob Roboter selbst moralische Akteure werden können, führt zu tiefgreifenden philosophischen Überlegungen:

- Können Maschinen ethische Prinzipien nicht nur befolgen, sondern verstehen? Aktuelle Systeme können Regeln befolgen, aber nicht deren Bedeutung erfassen.

- Ist maschinelles Bewusstsein möglich oder wünschenswert? Die Frage nach Bewusstsein ist eng mit der nach moralischem Status verknüpft.

- Welchen moralischen Status hätten bewusste Maschinen? Würden ihnen eigene Rechte zustehen?

Globale ethische Standards in einer diversen Welt

Die kulturelle Diversität stellt die Entwicklung globaler ethischer Standards vor Herausforderungen:

- Wie können wir kulturelle Unterschiede in ethischen Vorstellungen berücksichtigen? Was in einer Kultur als ethisch gilt, kann in einer anderen problematisch sein.

- Welche Werte sind universell, welche kulturspezifisch? Die Suche nach gemeinsamen ethischen Grundlagen bleibt eine Herausforderung.

- Wie vermeiden wir ethischen Imperialismus? Die Dominanz westlicher Werte in der Technologieentwicklung wirft Fragen der globalen Gerechtigkeit auf.

Langfristige Auswirkungen auf die Menschheit

Die langfristigen Konsequenzen der Robotisierung für die menschliche Entwicklung sind noch kaum absehbar:

- Wie verändert die Koexistenz mit intelligenten Maschinen unser Selbstverständnis als Menschen? Die Grenzen zwischen Mensch und Maschine werden zunehmend fließend.

- Welche menschlichen Fähigkeiten könnten durch Delegation an Maschinen verkümmern? Von praktischen Fertigkeiten bis zu sozialen und ethischen Kompetenzen.

- Wie sieht eine wünschenswerte Zukunft der Mensch-Roboter-Beziehung aus? Die Vision einer gelingenden Koexistenz muss aktiv gestaltet werden.

Fazit: Ethik als Gestaltungsaufgabe

Die Ethik der Robotik ist keine Randerscheinung oder nachträgliche Korrektur technologischer Entwicklungen, sondern eine zentrale Gestaltungsaufgabe. Sie fordert uns auf, grundlegende Fragen zu stellen: Welche Technologien wollen wir entwickeln? Welche Werte sollen sie verkörpern? Wie soll das Verhältnis zwischen Mensch und Maschine gestaltet sein?

Die Antworten auf diese Fragen sind nicht allein technischer Natur, sondern erfordern einen breiten gesellschaftlichen Dialog, der verschiedene Perspektiven, Wertvorstellungen und Interessen einbezieht. Nur so können wir sicherstellen, dass die Robotik zu einer Technologie wird, die menschliche Werte und Bedürfnisse respektiert und fördert, statt sie zu untergraben.

Die Zukunft der Robotik liegt nicht in den Händen der Roboter, sondern in unseren – in den Entscheidungen, die wir heute über ihre Entwicklung, Regulierung und Anwendung treffen. Diese Verantwortung sollten wir mit Weitsicht und ethischer Reflexion wahrnehmen, um eine Zukunft zu gestalten, in der Robotik zum Wohle aller beiträgt.